Штучний інтелект може перетворити автономну зброю на роботів-вбивць. Чому це дійсно страшно

Роботи почнуть вбивати самостійно, і це стане третьою воєнною революцією після винаходу пороху і атомної зброї. Так думають Ілон Маск та провідні експерти в галузі штучного інтелекту

Фахівці вимагають заборонити автономну зброю

116 провідних експертів в галузі робототехніки і штучного інтелекту (Artificial intelligence - AI) закликають Організацію Об'єднаних Націй (ООН) заборонити розробку і використання роботів-убивць. Серед цих фахівців - мільярдер і винахідник Ілон Маск.

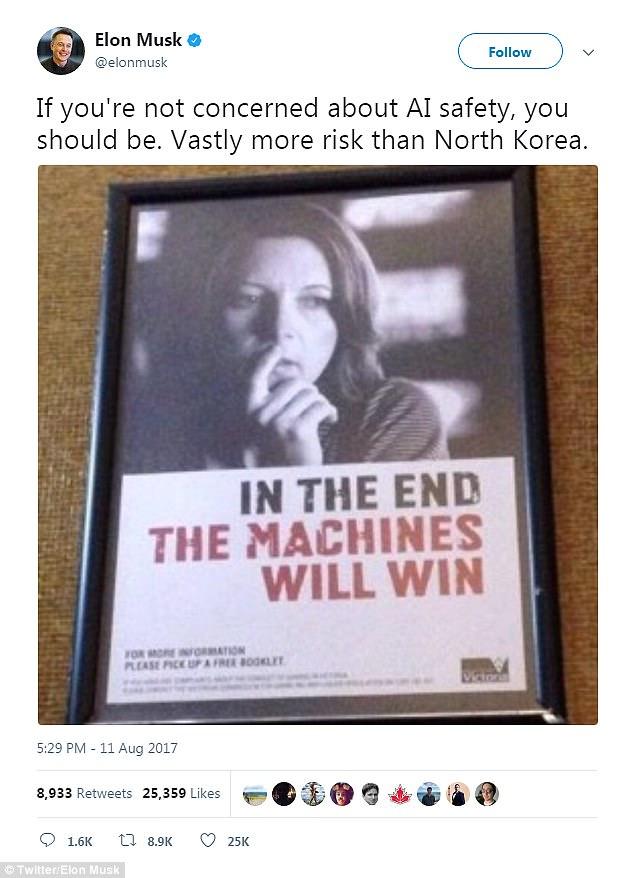

Це не перший раз, коли Маск закликає обережніше ставиться до нових розробок у сфері штучного інтелекту. Ще на початку серпня, коли AI обіграв досвідченого гравця DotA 2, мільярдер попередив про небезпеку штучного інтелекту. Маск вважає, що AI несе "набагато більший ризик", ніж ядерні можливості Північної Кореї.

Ілон Маск і Мустафа Сулейман (засновник компанії DeepMind Technologies, Google, яка займається розвитком технологій AI) очолили групу з 116 експертів з 26 країн. Усі вони закликають до заборони автономної зброї.

ООН ще 2015 року планувала конференцію, щоб обговорити застосування автономної зброї: безпілотні літальні апарати, танки та автоматичні кулемети. Однак тоді у організації забракло коштів, щоб заснувати новий комітет.

У листопаді ООН знову збирає конференцію, щоб обговорити відкладені питання. Напередодні цієї події, група засновників компаній AI та робототехніки відправила до ООН відкритого листа, що закликає запобігти гонці озброєнь, яка полягає в розробці роботів-убивць.

У своєму листі до ООН учасники попереджають, що ця гонка озброєнь з використанням робототехніки загрожує вступити в стадію «третьої воєнної революції» після винаходу пороху та ядерної зброї.

На думку експертів, подібна зброя тільки збільшить площу воєнних дій та кількість смертей мирних жителів. Автономна зброя перетвориться на інструмент терору, її використовуватимуть деспоти.

"Ми не повинні довго роздумувати. Тільки-но скринька Пандори відкриється, його буде важко закрити", - йдеться в листі.

Чому треба заборонити автономну зброю вже зараз

Експерти впевнені, що технологія AI досягла точки, коли виготовлення автономної зброї можливе вже за кілька років, а не десятиліть.

Штучний інтелект можна використовувати для того, щоб убезпечити поле битви для військових. Нехай роботи борються за людей. Однак фахівці побоюються, що якщо військові не будуть фізично брати участі в боях, то бій стане більш масштабним і смертоносним.

Страх за життя часто обмежує дії військових. Але у роботів технічно не буде подібних інстинктів - вони вбиватимуть без страху і жалю, якнайшвидше, поки не зламаються. Людині, на відміну від робота, потрібно набагато більше часу на прийняття рішення. Крім того, будь-яка техніка може дати збій, а комп'ютер може бути "зламаний" злочинцями.

"На відміну від інших потенційних проявів AI, які досі залишаються в межах наукової фантастики, автономні системи зброї вже зараз перебувать на порозі виготовлення. Вони можуть завдати багато шкоди мирним жителям і принести глобальну нестабільність", - розповів засновник Clearpath Robotics Райан Гарипов для the Guardian.

Саме тому група експертів на чолі з Маском і Сулейманом вимагають розширити список забороненої зброї, який був прийнятий конвенцією ООН 1983 року.

До списку забороненої зброї вже входять хімічна та біологічна зброя, засліплююча лазерна зброя, розривні боєприпаси, осколки яких неможливо виявити рентгенівським променем. Також конвенція обмежує можливість використання протипіхотних мін.

А чи не занадто пізно

Назва "роботи-вбивці" одразу викликає в уяві зображення з наукової фантастики - Термінатора або Robocop’а. Однак смертоносна автономна зброя вже використовується.

Наприклад, корейська компанія Samsung виробляє не тільки смартфони, а й бойових роботів з 2006 року. Зокрема, робот-страж Samsung SGR-A1 вже охороняє кордон між Північною Кореєю і Південною Кореєю.

Подібні роботи-прикордонники, яких компанія Samsung розробила на замовлення уряду, є першою у своєму роді автономною системою.

робот-вартовий Samsung SGR-A1

робот-вартовий Samsung SGR-A1

Технічно робот здатний стріляти самостійно. Він так само здатний "гукнути" порушнику кордону, і якщо людина не зможе сказати кодове слово, робот відкриє вогонь на ураження. Однак південнокорейський уряд заперечує, що роботів переведено в такий автономний режим. За їхніми словами, на даний момент роботами керує людина-оператор.

Але роботи-прикордонники вже не єдині автономні бойові системи. Наприклад, бойовий "невидимий" дрон Великої Британіі - "Taranis", названий на честь кельтського бога грому.

Це перший, автономний і невидимий бомбардувальник з великим радіусом дії. Оскільки дрон - автономний, оператора до нього не передбачено. Машина діятиме самостійно, згідно з програмою.

"Taranis" пройшов тестування ще 2013 року, в пустелі Австралії. Дрон може літати до 24 годин, розрізняти ціль і атакувати її без втручання людини.

Так само як і корейці, група британських розробників (BAE Systems) спочатку говорила, що не збираються використовувати дрон у бойових діях, а лише хотіли перевірити свої можливості. Однак вже 2030-го автономний дрон замінить пілотовані людиною літаки Tornado GR4 у британських ВВС.

У подібних "воїнів" є етична перевага - вони не відчувають ненависті або страху. Не вміють брехати, їх не можна переконати в чомусь. Подібні автоматизовані військові технології змінять характер війни. Скриньку Пандори вже відкрито, попри намагання Маска запобігти цьому.

- Актуальне

- Важливе